Маск, Возняк, Харари и другие эксперты IT-отрасли призывают приостановить разработку искусственного интеллекта

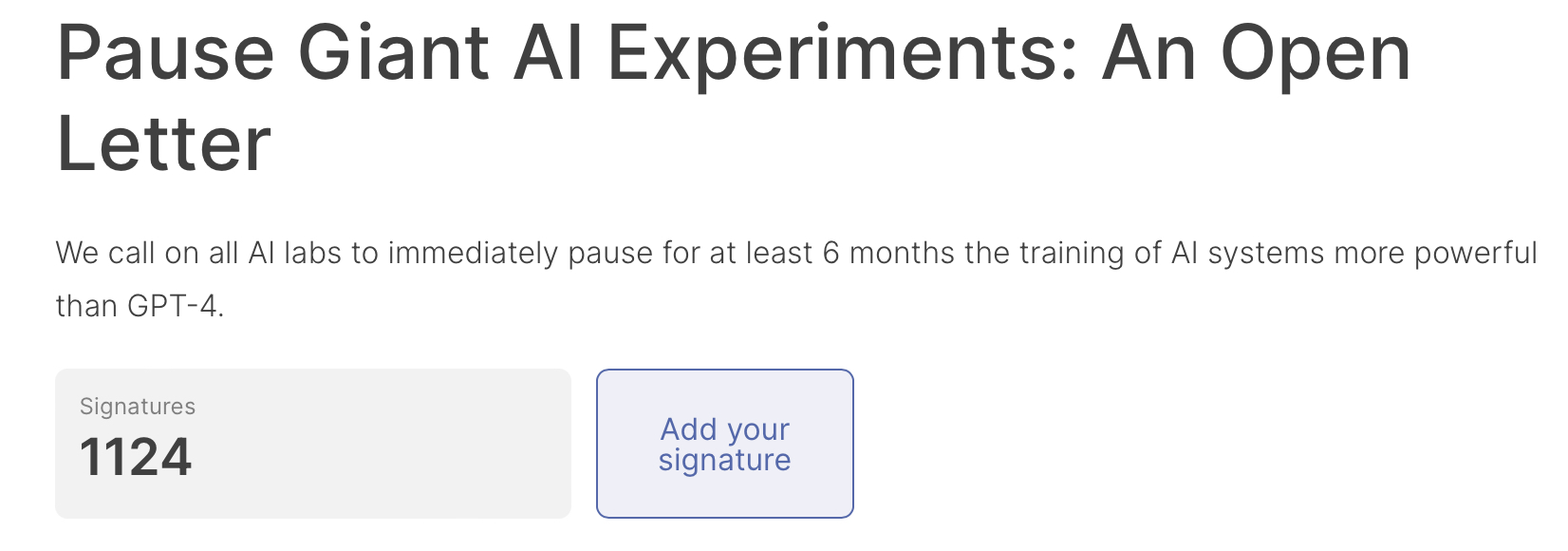

Более тысячи экспертов, среди которых Илон Маск, экс-соучредитель Apple Стив Возняк и израильский историк Юваль Ной Гарари, подписали открытое письмо с призывом приостановить разработку мощных систем на основе искусственного интеллекта, чтобы дать время убедиться в их безопасности. Об этом сообщает France24.

Подпишитесь на канал Gloss.ua в Telegram.

Эксперты считают, что ИИ с уровнем интеллекта, конкурирующим с человеческим, могут представлять серьезные риски для общества и человечества. По их мнению, обучение нейросетей нужно остановить, пока не появятся общие протоколы безопасности. А если обучение не получится остановить быстро, то власти «должны вмешаться и ввести мораторий».

Авторы письма утверждают, что даже создатели «мощных цифровых разумов» не могут контролировать их, а современные системы искусственного интеллекта начинают конкурировать с человеком.

Так, ведущая группа экспертов в сфере искусственного интеллекта (ИИ) и представителей ИТ-отрасли, среди который Илон Маск, сооснователь Apple Стив Возняк и еще более 1100 человек, подписали открытое письмо о рисках таких технологий для общества и призвали как минимум на полгода приостановить обучение нейросетей, превосходящих GPT-4.

«AGI может привести к большим изменениям в истории жизни на Земле… К сожалению, сейчас не наблюдается достаточного уровня планирования и управления, а в последние месяцы лаборатории ИИ вышли из-под контроля; никто не может понять, спрогнозировать и контролировать разработку и развертывание все более мощных цифровых умов — даже их создатели», — предостерегают эксперты.

«Системы на основе искусственного интеллекта с человеческим конкурентным интеллектом могут представлять серьезные риски для общества и человечества. Мощные системы на основе искусственного интеллекта следует разрабатывать только тогда, когда мы будем уверены, что их эффект будет положительным, а риски управляемыми», - сказано в письме.

Что умеет GPT-4?

Участники инициативы решили подписать открытое письмо после того, как стартап OpenAI выпустил новую модель на основе искусственного интеллекта GPT-4, которая намного мощнее предыдущей версии, использовавшейся для работы чат-бота ChatGPT, теперь нейросеть способна понимать не только текст, но и распознавать изображения – и может объяснить даже значение мемов. Разработчики утверждают, что GPT-4 может решать сложные задачи с большей точностью благодаря расширенным общим знаниям. Кроме того, обновленный бот научился на отлично сдавать сложные экзамены по математике и юриспруденции.

Исследовательская команда Microsoft оценила мощность GPT-4 близкой к человеческому уровню. Обновленную языковую модель назвали первым шагом к "общему искусственному интеллекту" (ОИИ), то есть способному на выполнение широкого круга задач.

Как результат, Future of Life Institute призывает все лаборатории ИИ поставить их исследования на шестимесячную паузу, чтобы подробнее изучить все вопросы, касающиеся безопасности технологии. В то же время, организация не призывает остановить разработку ИИ в целом, а скорее «отступить от опасной погони ко все большим и непредсказуемым моделям черного ящика с чрезвычайными возможностями».

Теги: технологии , искусственный интеллект , прогресс , информационные технологии , человечество , новости мира